Artículo de Javier Zurera, sobre la Gestión de la Capacidad en el Data Center

Debido a la Transformación Digital y el despegue del Internet de las Cosas, la nueva Industria 4.0 ya es una realidad, lo que conlleva que el control de las grandes factorías esté mucho más digitalizado y dependa la producción en gran medida del buen funcionamiento de la plataforma IT de la compañía. Es pues, en los centros de datos, donde se concentran la mayoría de las operaciones y donde recae toda la responsabilidad para que la empresa siga funcionando sin problemas.

En este caso, la gestión de la capacidad del centro de datos es vital para que el negocio siga funcionando. Un fallo en un data center o una incorrecta planificación del crecimiento del mismo por una mala gestión de la capacidad, puede hacer que el negocio se pare o se vea afectada su producción por no poder asignar los recursos IT necesarios que demande la compañía. Es responsabilidad del gestor del centro de datos, que éste sea capaz de adelantarse a las necesidades futuras, y a la vez sea óptimo y no esté sobredimensionado.

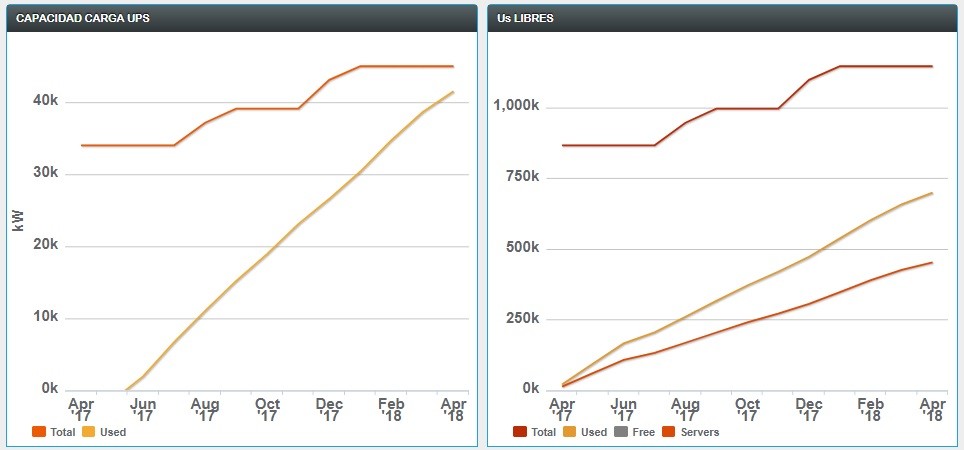

Para la gestión de la capacidad, es necesario disponer de las herramientas necesarias para poderse adelantar a los picos de carga, que puedan poder poner en riesgo nuestra infraestructura. Un buen ejemplo sería un sistema DCIM (Data Center Infraestructure Management), que monitorizará la carga CPU de cada equipo IT y también la demanda energética por rack además de la capacidad restante en la instalación en tiempo real. Por otro lado, definiendo unos buenos cuadros de mando (dashboards), donde se pueda ver la tendencia de nuestra instalación y también el histórico de años anteriores, podemos planificar de forma muy eficiente las necesidades a futuro de nuestro centro de datos. Adicionalmente, ajustando los niveles de advertencia de estos cuadros de mando, podemos adelantarnos a los requisitos de nuestra instalación para un plazo más largo de tiempo.

Gracias a los cuadros de mando, podemos ver el histórico y la tendencia de nuestra instalación. Es muy común que los picos cargas de trabajo se repitan periódicamente debido a trabajos recurrentes en las empresas, como pueden ser cierres contables (trimestrales, anuales…), campañas especiales (Navidad, verano…). Para estos picos de trabajo una solución interesante es la externalización de servicios no críticos en plataformas cloud públicas y dejar los recursos propios para dar servicio a esta demanda excepcional.

En el caso de que no se opte por una externalización de los servicios menos críticos, es también aconsejable valorar si estos requieren un nivel de redundancia igual que las plataformas más importantes. En muchos casos la gran mayoría del centro de datos se encuentra virtualizado en plataformas de alta disponibilidad. El propio hipervisor proporciona redundancia en el caso de que algún servidor físico tenga algún problema, moviendo automáticamente las máquinas virtuales a otro host que puede estar en otra parte del centro de datos o incluso en otro edificio. Por lo tanto es aconsejable valorar si realmente es necesaria una redundancia 2N+1, o incluso 2N para estos tipos de entornos. Quizás sería aconsejable la migración a una redundancia N, y la capacidad ganada administrarla para un futuro crecimiento del centro de datos.

En resumen, para poder tener una buena gestión de la capacidad es fundamental que exista una buena comunicación entre los diferentes departamentos involucrados: gestores del negocio, responsables IT y administradores del centro de datos. Con esto podremos adelantarnos a las necesidades de la empresa. La virtualización puede ser una gran aliada para gestionar la capacidad y ajustar la redundancia física según la criticidad del servicio. Importante detectar los picos de carga de nuestra instalación y no gestionarla a través de la medida del consumo de energía, ya que puede haber procesos puntuales que supongan un consumo alto puntual que pueda hacer que nuestra infraestructura se venga abajo.